Capítulo 6 Inferência Bayesiana

O paradigma da inferência bayesiana tem suas origens no artigo póstumo de (Bayes 1763), comunicado por seu amigo Richard Price. As derivações das ideias de Bayes são extensas e profundas matemática e filosoficamente, discutidas por grandes nomes da Ciência em incontáveis livros, artigos e compilações ao longo destes mais de 250 anos. Desta forma entende-se que a melhor abordagem para este material é indicar o estado-da-arte da aplicação bayesiana considerando referências consagradas disponíveis online ou na bilbioteca da PUCRS.

Um dos principais motivos dos avanços recentes na pesquisa em estatística bayesiana é a crescente facilidade no acesso a recursos computacionais, tanto de hardware quanto de software. Na linguagem R existem muitas bibliotecas para aplicação bayesiana. O CRAN Task View25 de inferência bayesiana fornece um compêndio atualizado dos pacotes relacionados ao assunto.

6.1 Princípio da verossimilhança

- Seção 1.6 de (Paulino, Turkman, and Murteira 2003)

- Seções 3.3 e 3.4 de (Press 2003) (Princípio da verossimilhança)

- Os fundamentos são discutidos por (Birnbaum 1962), (Savage et al. 1962) e (Wechsler, Pereira, and Marques 2008)

Informalmente, o princípio da verossimilhança admite que se dois decisores possuem o mesmo grau de conhecimento e a mesma informação sobre \(\theta\), ambos devem decidir exatamente da mesma forma a respeito de \(\theta\). (Berger 1985, 28)26 define da seguinte forma:

Princípio da verossimilhança Ao fazer inferências ou decisões sobre \(\theta\) após observar \(x\), todas as informações experimentais relevantes estão contidas na função de verossimilhança para o \(x\) observado. Além disso, duas funções de verossimilhança contêm as mesmas informações sobre \(\theta\) se forem proporcionais entre si (como funções de \(\theta\)).

Exemplo 6.1 (Princípio da Verossimilhança 1, adaptado de (Paulino, Turkman, and Murteira 2003)) Considere uma sucessão de lançamentos de uma moeda, independentes e condicionados por \(\theta\), a probabilidade de sair ‘cara’. Suponha que seja obtido o resultado \[x = \lbrace H,T,H,H,T,T,H,T,T,T \rbrace,\] onde \(H\): ‘cara’ e \(T\): ‘coroa’27. Este resultado poderia ser obtido de diversos processos experimentais ou regras de parada, como

- realizar 10 lançamentos, fixados a priori

- lançar a moeda até aparecerem 6 ‘coroas’

- lançar a moeda até aparecerem 3 ‘coroas’ consecutivas

- lançar a moeda até o jogador ficar saturado, tendo a saturação ocorrido no 10º lançamento

Exemplo 6.2 (Princípio da Verossimilhança 2, adaptado de (Lindley and Phillips 1976) por (Paulino, Turkman, and Murteira 2003)) Suponha que deseja-se testar a hipótese \(H_0 : \theta \le 1/2\) contra \(H_1 : \theta > 1/2\). São contemplados dois processos experimentais:

- \(E_1\): lançar a moeda \(n=12\) vezes;

- \(E_2\): lançar a moeda até que apareçam \(k=3\) ‘caras’

Admita que o resultado observado nas duas experiências foi \(x=9\) ‘coroas’ (portanto 3 ‘caras’), que é uma particular realização da variável aleatória \(X\), que designa o número total de ‘coroas’ dos experimentos \(E_1\) e \(E_2\). Para um clássico o nível crítico (ou valor-\(p\), a probabilidade de obter \(X \ge 9\)) da hipótese \(H_0 : \theta = 1/2\) difere nos dois casos.

No caso \(E_1\), \(X\) tem distribuição binomial – \(X \sim \mathcal{B} \left( 12, \theta \right)\) – cujo nível crítico é

\[\begin{equation} Pr\left( X \geq 9 \bigg\rvert \theta = \dfrac{1}{2} \right) = \binom {12}{9} \left( \frac{1}{2} \right) ^{12} + \binom {12}{10} \left( \frac{1}{2} \right) ^{12} + \binom {12}{11} \left( \frac{1}{2} \right) ^{12} + \binom {12}{12} \left( \frac{1}{2} \right) ^{12} \approx 0.0730. \nonumber \tag{6.1} \end{equation}\]

No caso \(E_2\), \(X\) tem distribuição binomial negativa – \(X \sim \mathcal{BN} \left( 3, 1-\theta \right)\) – que tem nível crítico

\[\begin{equation} Pr\left( X \geq 9 \bigg\rvert \theta = \dfrac{1}{2} \right) = \binom {11}{9} \left( \frac{1}{2} \right) ^{12} + \binom {12}{10} \left( \frac{1}{2} \right) ^{13} +\binom {13}{11} \left( \frac{1}{2} \right) ^{14} + \cdots \approx 0.0327. \nonumber \tag{6.2} \end{equation}\]

Logo, se for adotado um limiar de significância de \(5 \%\), \(H_0\) é rejeitada no caso \(E_2\) e não rejeitada em \(E_1\). Assumindo o princípio da verossimilhança, as conclusões devem ser idênticas nos dois casos. Em ambos a (função de) verossimilhança é proporcional a \(\theta^9 \left( 1 - \theta \right)^3\). De fato, as verossimilhanças em \(E_1\) e \(E_2\) são

\[L_1 \left( \theta \right| x = 9 ) = \binom {12}{9} \theta^{9} \left( 1-\theta \right) ^{3} = 220 \; \theta^{9} \left( 1-\theta \right)^{3} \propto \theta^{9} \left( 1-\theta \right)^{3}\]

\[L_2 \left( \theta \right| x = 9 ) = \binom {11}{9} \theta^{9} \left( 1-\theta \right) ^{3} = 55 \; \theta^{9} \left( 1-\theta \right)^{3} \propto \theta^{9} \left( 1-\theta \right)^{3}\]6.2 Distribuição a priori

- Fundamentos abordados no Capítulo 2 de (Paulino, Turkman, and Murteira 2003) e no Capítulo 5 de (Press 2003)

- (Morris, Oakley, and Crowe 2014) apresentam uma ferramenta baseada na web para obter distribuições de probabilidade de especialistas

Exemplo 6.3 (Usando bayesiana) Seja uma moeda com probabilidade \(\theta\) de face cara. A variável aleatória X: número de faces coroa em $n$ lançamentos (condicionalmente independentes) tem distribuição Binomial com probabilidade \(\theta\) de sucesso, anotada por \(X|\theta \sim B(n,\theta)\). Assim, a (função de) verossimilhança de \(X|\theta\) é dada por

\[\begin{equation} \pi(x|\theta)={n \choose x} \theta^x (1-\theta)^{n-x} \propto \theta^x (1-\theta)^{n-x} \tag{6.3} \end{equation}\]

Por conveniência, a (distribuição a) priori de \(\theta\) é admitida como uma Beta de parâmetros (de forma) \(\alpha\) e \(\beta\), anotada por \(\theta \sim Beta(\alpha,\beta)\).

\[\begin{equation} \pi(\theta) = \dfrac{\Gamma(\alpha+\beta)}{\Gamma(\alpha)+\Gamma(\beta)} \theta^{\alpha-1} (1-\theta)^{\beta-1} \propto \theta^{\alpha-1} (1-\theta)^{\beta-1} \tag{6.4} \end{equation}\]

A conveniência em escolher uma verossimilhança Binomial para \(X|\theta\) e uma priori Beta para \(\theta\) reside no fato de estas distribuições serem conjugadas, i.e., ao realizar a operação bayesiana obtém-se uma distribuição a posteriori Beta com os parâmetros da priori atualizados pelo número de caras (sucessos) \(x\) e de coroas (fracassos) \(n-x\) na amostra, anotada por \(\theta|X \sim Beta(\alpha+x,\beta+n-x)\).

\[\begin{align} \pi(\theta|x) &\propto \pi(\theta) \pi(x|\theta) \notag \\ &\propto \theta^x (1-\theta)^{n-x} \theta^{\alpha-1} (1-\theta)^{\beta-1} \notag \\ \pi(\theta|x) &\propto \theta^{\alpha+x-1} (1-\theta)^{\beta+n-x-1} \tag{6.5} \end{align}\]

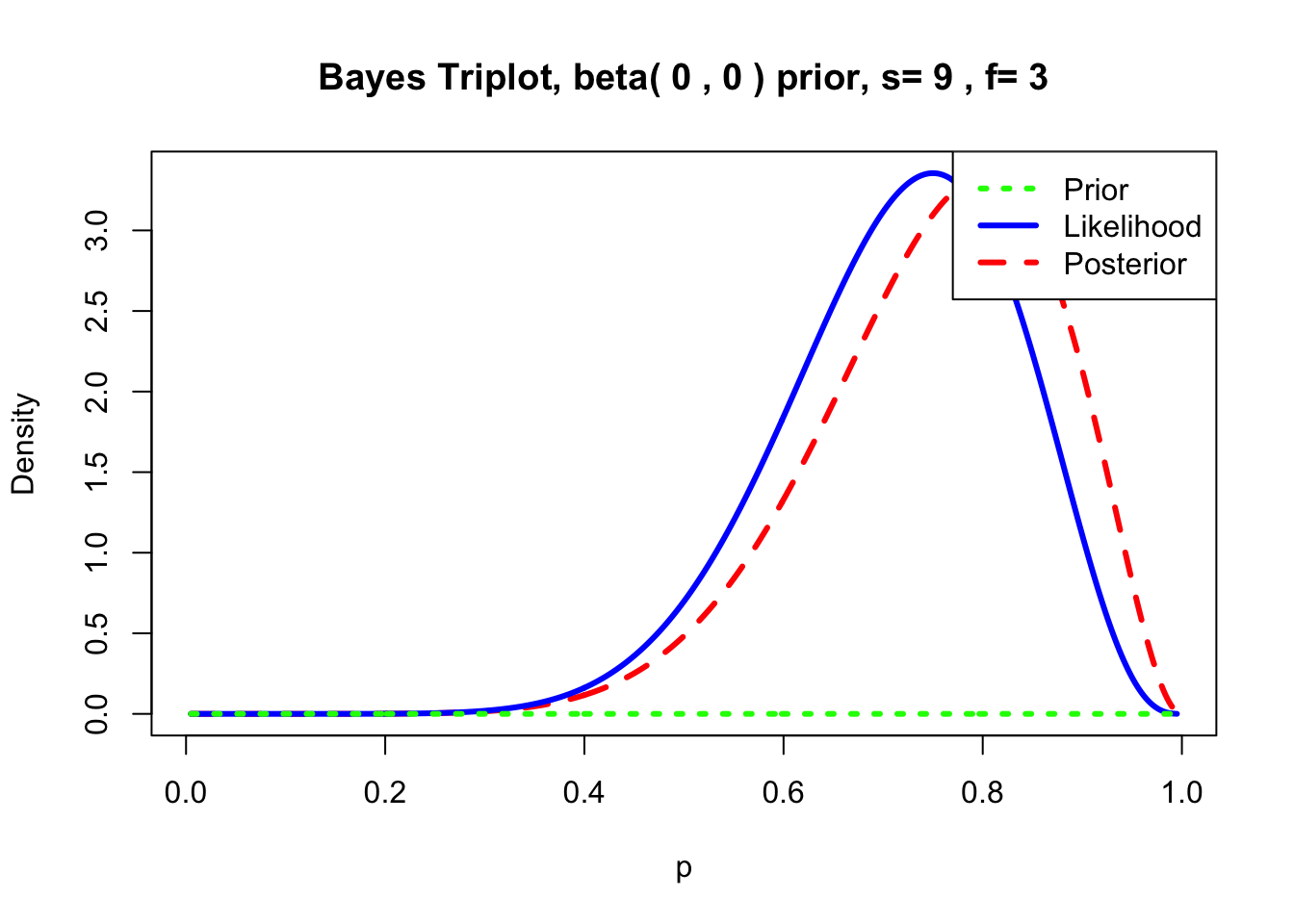

Admitindo uma priori \(Beta(0,0)\) para \(\theta\), \(n=12\) lançamentos com 9 sucessos (coroas) e 3 fracassos (caras).library(LearnBayes)

prior <- c(0,0) # priori beta(0, 0) para \theta

data <- c(9,3) # 9 sucessos e 3 fracassos

triplot(prior,data)

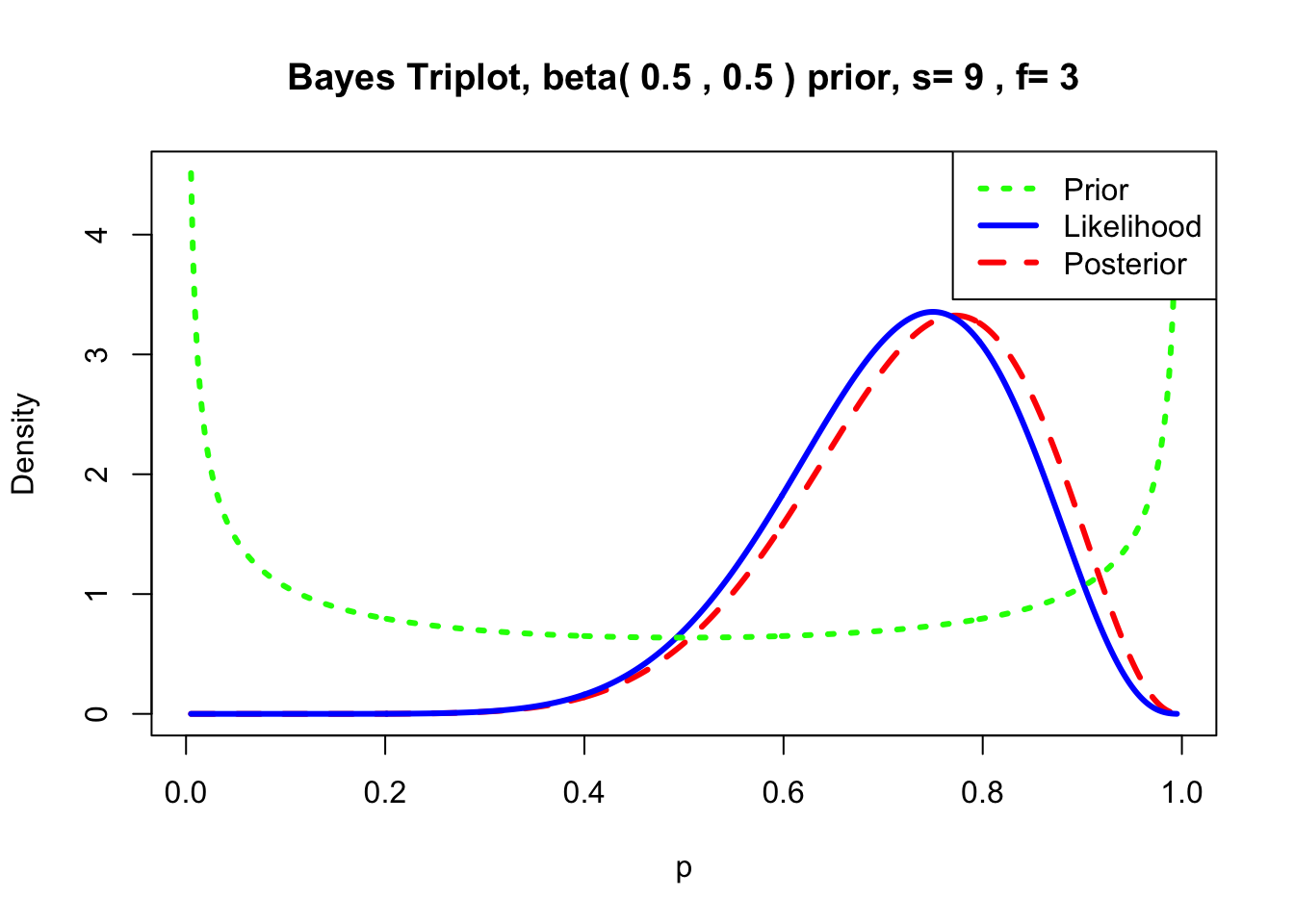

Admitindo uma priori de Jeffreys \(Beta(1/2,1/2)\) para \(\theta\), novamente para \(n=12\) lançamentos com 9 sucessos (coroas) e 3 fracassos (caras).

library(LearnBayes)

prior <- c(1/2,1/2) # priori de Jeffreys beta(1/2, 1/2) (arco-seno) para \theta

data <- c(9,3) # 9 sucessos e 3 fracassos

triplot(prior,data)

6.3 Estimação Pontual

6.4 (Estimação por) Intervalo/Regiões de Credibilidade

6.5 (Estimação por) Teste de Hipóteses

6.5.1 Fatores de Bayes

Referências

Bayes, Thomas. 1763. “An Essay Towards Solving a Problem in the Doctrine of Chances. By the Late Rev. Mr. Bayes, FRS Communicated by Mr. Price, in a Letter to John Canton, AMFR S.” Philosophical Transactions of the Royal Society of London, no. 53: 370–418. https://www.ias.ac.in/article/fulltext/reso/008/04/0080-0088.

Berger, James O. 1985. Statistical Decision Theory and Bayesian Analysis. 2nd ed. Springer Science & Business Media. https://www.springer.com/gp/book/9780387960982.

Birnbaum, Allan. 1962. “On the Foundations of Statistical Inference.” Journal of the American Statistical Association 57 (298): 269–306. https://www.jstor.org/stable/2281640.

Kass, Robert E, and Adrian E Raftery. 1995. “Bayes Factors.” Journal of the American Statistical Association 90 (430): 773–95. http://xyala.cap.ed.ac.uk/teaching/tutorials/phylogenetics/Bayesian_Workshop/PDFs/Kass%20and%20Raftery%201995.pdf.

Lindley, Dennis V, and LD Phillips. 1976. “Inference for a Bernoulli Process (a Bayesian View).” The American Statistician 30 (3): 112–19. https://www.jstor.org/stable/2683855.

Morris, David E, Jeremy E Oakley, and John A Crowe. 2014. “A Web-Based Tool for Eliciting Probability Distributions from Experts.” Environmental Modelling & Software 52: 1–4. http://dx.doi.org/10.1016/j.envsoft.2013.10.010.

Paulino, Carlos Daniel Mimoso, Maria Antónia Amaral Turkman, and Bento Murteira. 2003. Estatı́stica Bayesiana. Fundação Calouste Gulbenkian, Lisboa. http://primo-pmtna01.hosted.exlibrisgroup.com/PUC01:PUC01:puc01000334509.

Pereira, Carlos A de B, Julio Michael Stern, Sergio Wechsler, and others. 2008. “Can a Significance Test Be Genuinely Bayesian?” Bayesian Analysis 3 (1): 79–100. https://projecteuclid.org/download/pdf_1/euclid.ba/1340370562.

Pereira, Carlos Alberto de Bragança, and Julio Michael Stern. 1999. “Evidence and Credibility: Full Bayesian Significance Test for Precise Hypotheses.” Entropy 1 (4): 99–110. https://www.mdpi.com/1099-4300/1/4/99.

Pereira, Carlos Alberto de Brgança, and Julio Michael Stern. 2020. “The E-Value: A Fully Bayesian Significance Measure for Precise Statistical Hypotheses and Its Research Program.” https://doi.org/10.1007/s40863-020-00171-7.

Press, S James. 2003. Subjective and Objective Bayesian Statistics: Principles, Models, and Applications, 2nd. Edition. John Wiley & Sons. http://primo-pmtna01.hosted.exlibrisgroup.com/PUC01:PUC01:oclc(OCoLC)587388980.

Savage, Leonard J, George Barnard, Jerome Cornfield, Irwin Bross, IJ Good, DV Lindley, CW Clunies-Ross, et al. 1962. “On the Foundations of Statistical Inference: Discussion.” Journal of the American Statistical Association 57 (298): 307–26. https://www.jstor.org/stable/2281641.

Wechsler, Sérgio, Carlos Alberto de Bragança Pereira, and P. C. F. Marques. 2008. “Birnbaum’s Theorem Redux.” https://www.ime.usp.br/~pmarques/papers/redux.pdf.

Segundo a documentação oficial do R, os CRAN Task Views (‘Visualizadores de Tarefa da Rede Abrangente de Arquivos R’, em tradução livre) têm como objetivo fornecer alguma orientação sobre quais pacotes no CRAN são relevantes para tarefas relacionadas a um determinado tópico. Eles fornecem uma breve visão geral dos pacotes incluídos têm como objetivo ter um foco nítido para que seja suficientemente claro quais pacotes devem ser incluídos (ou excluídos) - e não têm a intenção de endossar os “melhores” pacotes para uma determinada tarefa.↩︎

“The Likelihood Principle. In making inferences or decisions about \(\theta\) after x is observed, all relevant experimental information is contained in the likelihood function for the observed x. Furthermore, two likelihood functions contain the same information about \(\theta\) if they are proportional to each other (as functions of \(\theta\)).” (Berger 1985, 28)↩︎

Do Inglês Head (cara) e Tail (coroa).↩︎